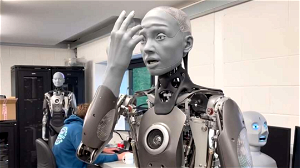

Une firme britannique travaille à donner des expressions aussi humaines que possibles aux robots, afin de « faciliter » nos interactions avec eux. Le résultat est bluffant, mais aussi assez inquiétant.

Qui s’intéresse à la science-fiction ne peut pas être passé à côté d’Isaac Asimov, le génial écrivain russo-américain qui, dans son Cycle des robots, décrit une société humaine servie par une classe à part d’êtres artificiels humanoïdes, mais de plus en plus dotés d’une conscience propre. Un monument littéraire novateur, qui semble en passe de tourner à la prophétie, si on le compare avec les progrès actuels des intelligences artificielles et de la mécanique humanoïde. Et on vient d’esquisser un nouveau pas dans cette direction, avec la recherche sur des robots capables de nous montrer des émotions, par le langage facial et corporel.

Une innovation sur laquelle travaille la firme britannique Engineered Arts avec son nouveau robot, baptisé Ameca. Attention : il ne s’agit pas là d’une technologie comparable à celle de l’entreprise russe Promobot qui offre 200.000 dollars pour avoir le droit de reproduire le visage d’une personne sur un robot. Ameca, lui, est doté de tout un jeu de muscles faciaux synthétiques, ainsi que d’une précision exceptionnelle dans ses mouvements afin de reproduire au mieux les expressions typiquement humaines : haussement d’épaules, écarquillement des yeux, bouche bée d’étonnement, ou encore, ce que nous sommes les seuls à faire dans le règne animal, un sourire bienveillant.

L’idée derrière le projet consiste à nous offrir une interface avec le monde digital alternative à un écran, et qui serait plus adaptée à notre manière naturelle de communiquer avec nos semblables. « Au lieu de regarder des écrans et de taper sur des claviers, nous devrions pouvoir communiquer avec notre technologie de manière plus humaine – les machines devraient comprendre un sourire, un mouvement de tête ou un geste de la main », écrit Engineered Arts à IFLScience. « Les robots ont besoin de visages et de mains pour communiquer avec nous – parce que c’est tellement plus naturel et facile à comprendre. »

Ameca n’exprime bien sûr pas ses propres émotions : le robot a appris à interpréter et copier les nôtres à l’aide de bases de données, et la machine embarque une IA capable de reconnaître l’expression d’un interlocuteur humain et de réagir en fonction. C’est déjà très perturbant.

Difficile en effet, en regardant ces images des premiers tests d’Ameca de ne pas songer au film I, Robot – d’ailleurs adapté d’une nouvelle d’Asimov – ou à d’autres œuvres de science-fiction dans lesquelles les machines finissent par exprimer leurs propres opinions aux humains, et pas toujours d’une manière pacifique. Les réseaux sociaux, Twitter en particulier, n’ont d’ailleurs pas manqué d’établir ce parallèle.

Ameca reflète en fait très bien le concept de « vallée de l’étrange » (Uncanny Valley), inventé dans les années 1970 et qui désigne le fait que, lorsqu’un objet atteint un certain degré de ressemblance anthropomorphique, il provoque une sensation d’angoisse et de malaise. En théorie celle-ci ne sera vraiment surmontée que quand les androïdes seront physiquement indiscernables des humains. Une autre prémisse chère à la science-fiction.