Intégrer un chatbot à son moteur de recherche ne représente pas qu’un défi technologique, cela entraine également des coûts supplémentaires colossaux par rapport aux recherches traditionnelles. Et il faudra certainement un moment aux géants du web pour maitriser ces coûts.

L’actualité : un échange avec l’IA va coûter près de 10 fois plus cher à Google qu’une simple recherche par mot-clé, explique le président d’Alphabet, John Hennessy, à Reuters.

Le détail : les revenus des annonces liées à ces recherches ne permettront pas d’équilibrer le tout.

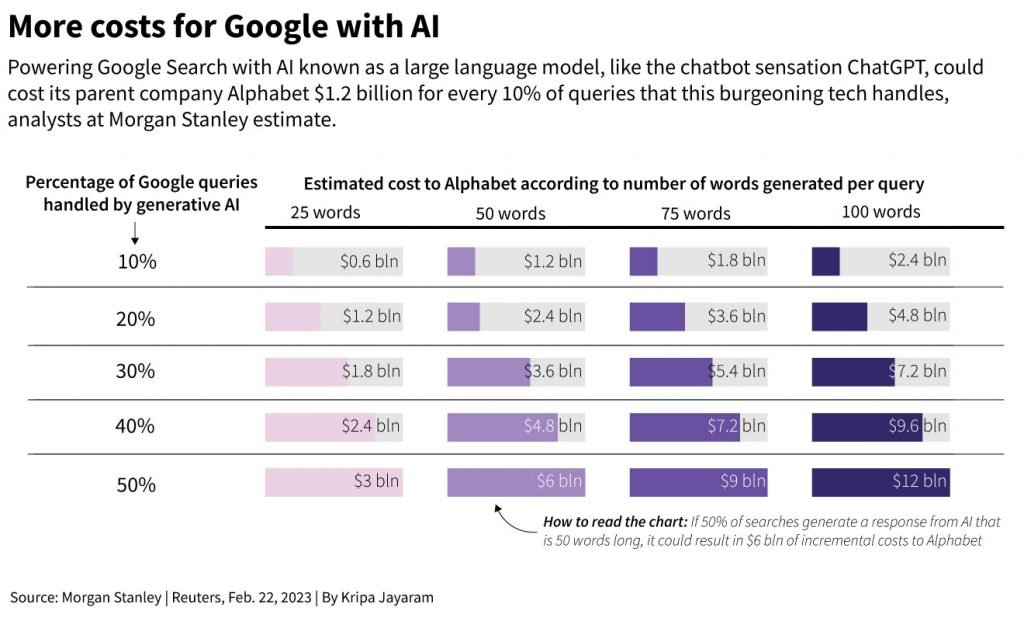

- Google pourrait faire face à une augmentation de 6 milliards de dollars de ses dépenses d’ici 2024 si les recherches basées sur l’IA représentaient la moitié des requêtes faites sur son moteur de recherche, sur base d’une réponse de 50 mots, estiment des analystes.

À noter : les coûts informatiques générés par les requêtes sur ChatGPT sont « exaspérants » tant ils sont minimes, de l’ordre de quelques centimes par conversation – en fonction de la taille des échanges. Cela s’explique par le fait qu’OpenIA a travaillé à améliorer l’efficacité du processus de réponse de son IA, mais aussi que cette version de ChatGPT repose en réalité sur plusieurs générations d’IA.

Optimiser pour limiter les coûts : SemiAnalysis, une société de recherche et de conseil axée sur la technologie des puces, mise plutôt sur un coût supplémentaire de « seulement » 3 milliards de dollars, grâce à l’utilisation des puces internes de Google, les fameuses Tensor Processing Units.

- Une vision partagée par le président d’Alphabet. Ce dernier est en effet convaincu qu’en procédant à des réglages précis, les coûts des recherches via l’IA baisseront rapidement.

- Autre solution envisagée : proposer une version plus ciblée de son IA LaMDA (Language Model for Dialogue Applications) sur laquelle repose Bard. Le chatbot intégré à Google Search serait ainsi moins gourmand en ressources, tout en répondant parfaitement aux besoins des utilisateurs.

Pourquoi ce type de recherche coûte plus cher ?

Ce qui différencie la recherche conventionnelle de celle boostée à l’IA est la puissance de calcul impliquée pour fournir une réponse.

- Une intelligence artificielle générative a besoin de processeurs valant des milliards de dollars pour fonctionner.

- À cela s’ajoutent évidemment les coûts de l’électricité utilisée pendant le processus, ainsi que les pressions faites aux entreprises pour limiter leur empreinte carbone.

Deux fonctionnements différents :

- Dans le cas d’une recherche traditionnelle, les robots d’exploration de Google scannent le web et compilent un index d’informations.

- Alors que pour une requête via l’IA, cette dernière déduit une réponse à une question à partir d’un entraînement préalable et d’une base de données – ou directement de la toile.

Pour l’heure, il est encore trop tôt pour déterminer exactement combien l’ajout de chatbot dans les moteurs de recherche pourrait coûter, car l’efficacité et l’utilisation varient considérablement en fonction de la technologie impliquée, selon une source proche de Google.

Le jeu en vaut la chandelle

Bien que conscient que les recherches via l’IA vont générer des coûts supplémentaires colossaux, Alphabet se montre plutôt optimiste quant à ses capacités à les réduire grâce à des ajustements.

Son désormais principal concurrent sur ce secteur, Microsoft, se montre lui aussi optimiste.

- La directrice financière de l’entreprise, Amy Hood, déclare que l’avantage de gagner des utilisateurs et des revenus publicitaires l’emportait sur les dépenses, rapporte Reuters.

- « C’est une marge brute supplémentaire pour nous, même au prix du service dont nous discutons », ajoute-t-elle.

« La technologie devient moins chère à grande échelle et avec le temps »

Richard Socher, PDG du moteur de recherche You.com

Malgré cet optimisme, le coût que représente l’intégration de l’IA à ses services est l’une des principales raisons pour lesquelles les géants de la recherche et des réseaux sociaux n’ont pas déployé cette technologie du jour au lendemain, selon Paul Daugherty, directeur de la technologie d’Accenture.