L’intelligence artificielle offre de nouvelles opportunités pour manipuler très facilement des enregistrements audio et vidéo, ce qui pose de nouveaux risques, avertit Will Knight, spécialiste de l’automatisation du magazine MIT Technology Review. Il explique que la technologie permet d’imiter des personnes de plus en plus facilement, et ce avec une précision étonnante. Il est possible de créer des sosies parfaits, de simuler des mouvements, des expressions faciales, et des dialogues.Par conséquent, à l’avenir, il sera de plus en plus difficile de distinguer les fausses informations des vraies, et il sera encore plus crucial d’aborder les enregistrements audio et vidéo et les images avec une certaine méfiance afin d’éviter d’être trompé par un contenu créé de toute pièce pour nous manipuler.

Lyrebird et les autres

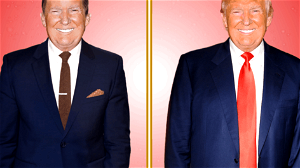

Lyrebird – une société dérivée de l’Université de Montréal – a développé une technologie qui permet d’imiter parfaitement la voix d’une personne.« Les enregistrements de voix sont actuellement considérés comme des pièces probantes dans nos sociétés, en particulier dans la juridiction de nombreux pays. Notre technologie, qui permet de manipuler facilement les enregistrements audio, questionne la validité de telles preuves. Cela pourrait potentiellement avoir des conséquences dangereuses », peut-on lire sur le site de cette entreprise. Certains demandent déjà la remise en cause du recours possible des enregistrements audio et vidéo en tant que preuves dans les procès.FaceApp, une application pour smartphone, permet d’ajouter un sourire sur le visage d’une personne, de lui faire changer de sexe, d’effacer ses rides, ou au contraire, de vieillir son apparence, et même d’éclaircir la couleur de sa peau.Dans les deux cas, les algorithmes d’intelligence artificielle ne se contentent plus d’analyser des données ; ils sont capables de créer du contenu. « Il est tout à fait possible de former un réseau de technologie pour lui apprendre à générer des contenus ex nihilo qui ressemblent de façon frappante à la cible réelle. »

Démasquer ces faux contenus

Etant donné l’émergence de ces nouvelles technologies, il devient nécessaire de développer une technologie capable de démasquer les faux enregistrements vidéo ou audio.Justus Thies, un spécialiste de la technologie à l’Université Friedrich Alexander en Allemagne, a annoncé le développement d’une application visant à détecter les manipulations de vidéos.